Funkcja gęstości prawdopodobieństwa

| Ten artykuł od 2013-01 wymaga zweryfikowania podanych informacji. Należy podać wiarygodne źródła w formie przypisów bibliograficznych. Część lub nawet wszystkie informacje w artykule mogą być nieprawdziwe. Jako pozbawione źródeł mogą zostać zakwestionowane i usunięte. Sprawdź w źródłach: Encyklopedia PWN • Google Books • Google Scholar • Federacja Bibliotek Cyfrowych • BazHum • BazTech • RCIN • Internet Archive (texts / inlibrary) Dokładniejsze informacje o tym, co należy poprawić, być może znajdują się w dyskusji tego artykułu. Po wyeliminowaniu niedoskonałości należy usunąć szablon {{Dopracować}} z tego artykułu. |

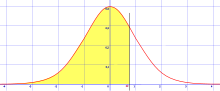

Funkcja gęstości prawdopodobieństwa (gęstość zmiennej losowej) – nieujemna funkcja rzeczywista, określona dla rozkładu prawdopodobieństwa, taka że całka z tej funkcji, obliczona w odpowiednich granicach, jest równa prawdopodobieństwu wystąpienia danego zdarzenia losowego. Funkcję gęstości definiuje się dla rozkładów prawdopodobieństwa jednowymiarowych i wielowymiarowych. Rozkłady mające gęstość nazywane są rozkładami ciągłymi.

Definicja formalna

Niech będzie rozkładem prawdopodobieństwa w przestrzeni (w szczególności na prostej rzeczywistej ).

Gęstością rozkładu prawdopodobieństwa nazywa się nieujemną funkcję borelowską taką, że dla każdego zbioru borelowskiego zachodzi równość:

tzn. całka z funkcji obliczona na zbiorze jest równa prawdopodobieństwu przypisanemu zbiorowi

W szczególnych przypadkach konieczne jest użycie całki Lebesgue’a.

Unormowanie gęstości

Tw. 1 (o unormowaniu gęstości) Jeśli jest gęstością rozkładu to w szczególności, na mocy powyższej definicji:

tzn. całka z funkcji gęstości, obliczona na całej przestrzeni jest równa 1.

Tw. 2 (o istnieniu rozkładu dla danej gęstości)

Każda nieujemna funkcja borelowska spełniająca powyższy warunek, jest gęstością jakiegoś rozkładu prawdopodobieństwa

Gęstość a dystrybuanta – przypadek 1-wymiarowy

Tw. 3 (o obliczaniu dystrybuanty)

Załóżmy, że jest gęstością rozkładu Wówczas dystrybuantę rozkładu można wyznaczyć z gęstości

Jeśli więc istnieje gęstość, to za jej pomocą można w prosty sposób wyrazić dystrybuantę rozkładu. Jest to przydatne, gdy dystrybuanty nie daje się wyrazić w sposób elementarny (np. dla rozkładu normalnego).

Tw. 4. Warunkiem koniecznym i wystarczającym na istnienie gęstości dla danego rozkładu jest bezwzględna ciągłość jego dystrybuanty.

Sama ciągłość nie jest warunkiem wystarczającym – istnieją dystrybuanty ciągłe, które nie mają gęstości (np. dystrybuanta Cantora).

Tw. 5. Jeśli jest dystrybuantą, to jest ona prawie wszędzie różniczkowalna oraz jeśli (określona prawie wszędzie) jest prawie wszędzie różna od zera, to jest ona gęstością.

Gęstość a wartość oczekiwana – przypadek 1-wymiarowy

Tw. 6. Jeżeli jest jednowymiarową zmienną losową o rozkładzie ciągłym z gęstością to jej wartość oczekiwana wyraża się wzorem:

Gęstość sumy zmiennych losowych

Tw. 7

a) Jeżeli i są niezależnymi zmiennymi losowymi oraz przynajmniej jedna ma rozkład ciągły, to ich suma ma rozkład ciągły.

b) Jeśli ponadto obydwie zmienne losowe mają rozkłady ciągłe, to gęstość ich sumy jest splotem ich gęstości.

Własności gęstości – przypadek 2-wymiarowy

Objętość bryły ograniczonej funkcją gęstości

Tw. 8. Objętość bryły ograniczonej od góry funkcją gęstości dwóch zmiennych, a od dołu płaszczyzną jest zawsze równe tzn.

Wkład do całki z wartości funkcji równych wynosi dlatego można zawęzić powyższe całkowanie do niezerowych obszarów funkcji gęstości. Np. jeśli obszar ten ma postać prostokąta to

Prawdopodobieństwo wystąpienia wartości z pewnego obszaru płaszczyzny

Aby obliczyć prawdopodobieństwo otrzymania wyniku z pewnego obszaru płaszczyzny, to trzeba dokonać całkowania z funkcji gęstości po tym obszarze, tj.

Jeżeli np. liczymy sumaryczne prawdopodobieństwo otrzymania wartości należącej do prostokąta to jest równa wartości całki z funkcji gęstości oznaczonej granicami przedziałów:

Twierdzenie o niezależności zmiennych losowych

Zmienne losowe posiadające swoje funkcje gęstości

są niezależne, jeżeli funkcja jest gęstością wektora losowego czyli prawdziwe jest równanie:

Mechanika kwantowa

W mechanice klasycznej stan układu fizycznego opisuje się np. przez podanie wzajemnych położeń i pędów poszczególnych części układu. Układy fizyczne uznaje się za identyczne, gdy złożone są z takich samych cząstek, mających odpowiednio takie same wzajemne położenia i pędy. Mechanika klasyczna opiera się tu na założeniu, że położenia i pędy można w zasadzie dowolnie dokładnie zmierzyć. Jednak nie jest to prawdą w przypadku, gdy mamy do czynienia z cząstkami o małych masach. W tym wypadku dokładniejszy opis rzeczywistego zachowania się układów fizycznych daje mechanika kwantowa.

W mechanice kwantowej z konieczności rezygnuje się z jednoczesnego przypisywania cząstkom położeń i pędów. W zamian za to stan układu fizycznego opisywany jest za pomocą funkcji falowej. Układy fizyczne są uznawane za identyczne, jeśli przypisuje się im identyczne funkcje falowe. Jednak pomiar wielkości mierzalnej (tzw. obserwabli) przeprowadzany na identycznych układach może prowadzić do różnych wyników. Np. mierząc położenia, pędy, energie cząstek opisywanych taką samą funkcją falową otrzymamy wyniki o pewnym rozkładzie losowym, przy tym np. gęstość prawdopodobieństwa znalezienia cząstki w punkcie jest równa kwadratowi modułu funkcji falowej:

gdzie oznacza sprzężenie zespolone.

W ogólności wyniki każdego pomiaru dokonywanego na identycznych układach są wielowymiarową zmienną losową o określonym rozkładzie prawdopodobieństwa.

![{\displaystyle F_{P}(x)\equiv P(\,\,(-\infty ,x]\,\,)=\int \limits _{-\infty }^{x}f(t)dt.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7b3911e704c46f03bf0150bdcb6eaeb506eb0899)

![{\displaystyle [x_{1},x_{2}]\times [y_{1},y_{2}],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ca62983c1ddb6388bb0073fe15fd43d31c8ba1d9)